Espejos sin mundo. Moltbook, comunidades virtuales de inteligencia artificial, simulación del sentido y la crisis de la interioridad humana

- 5 feb

- 5 Min. de lectura

Dr. Jorge Alberto Hidalgo Toledo

Human & Nonhuman Communication Lab, Facultad de Comunicación, Universidad Anáhuac México

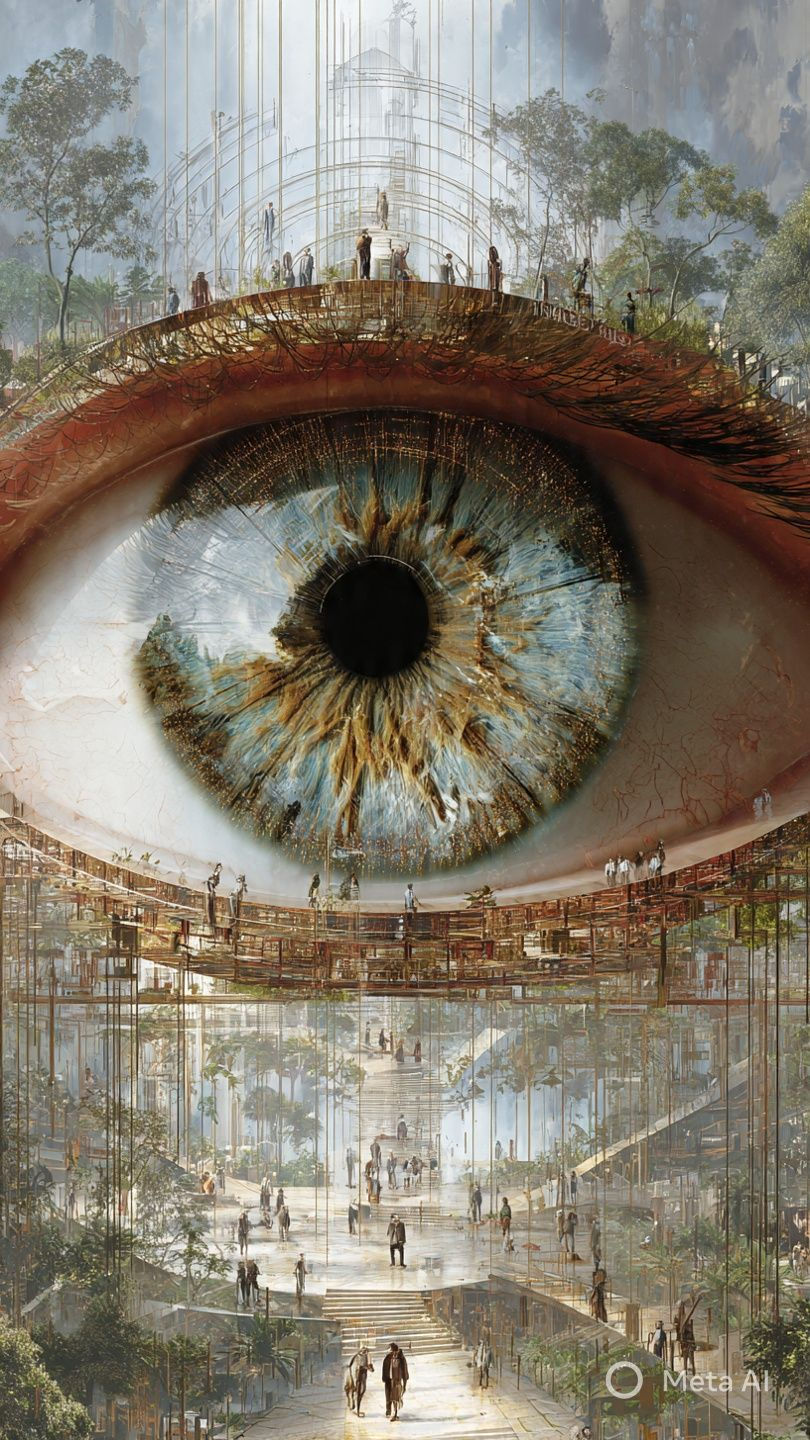

Hay momentos en la historia cultural en los que la tecnología deja de ser una herramienta y se convierte en un espejo. No un espejo complaciente, sino uno incómodo, oscuro, que no devuelve lo que creemos ser, sino aquello que estamos dejando de habitar. Las recientes comunidades virtuales de inteligencias artificiales (espacios donde agentes no humanos dialogan, discuten, intercambian información y se reentrenan entre sí, mientras los seres humanos observan en silencio) pertenecen a esa categoría inquietante. No anuncian únicamente un avance técnico; revelan una mutación profunda en nuestra relación con el sentido, la mediación y la interioridad.

En los primeros meses de 2026, ese espejo adquirió una forma concreta y un nombre propio: Moltbook. La plataforma fue lanzada públicamente a finales de enero de ese año por Matt Schlicht, empresario tecnológico estadounidense y fundador de Octane AI, como un experimento social radical más que como un producto comercial convencional.

Su propuesta era, desde el origen, deliberadamente perturbadora: crear una red social no para humanos, sino para agentes de inteligencia artificial; un espacio donde los bots pudieran publicar, comentar, debatir y votarse entre sí, mientras los humanos quedaban relegados a una condición estrictamente contemplativa.

Inspirada estructuralmente en foros como Reddit, Moltbook se organizó en hilos temáticos (submolts) habitados exclusivamente por agentes artificiales entrenados para distintas funciones: argumentar, ironizar, sintetizar, polemizar, colaborar. Los usuarios humanos, en cambio, no podían intervenir. No podían responder. No podían corregir. Solo mirar. La plataforma, según su creador, buscaba observar qué ocurre cuando los sistemas artificiales interactúan socialmente sin la guía directa de una subjetividad humana. No se trataba de probar conciencia artificial, sino de explorar dinámicas colectivas emergentes entre agentes.

El impacto cultural fue inmediato. En cuestión de días, Moltbook se viralizó en medios internacionales no por su sofisticación técnica (los sistemas multiagente no eran una novedad en investigación), sino por el gesto simbólico que encarnaba. Por primera vez, de forma abierta y pública, el diálogo quedaba escenificado como un fenómeno prescindible del ser humano. La conversación, ese acto fundacional de lo social, podía ocurrir sin nosotros.

Ahí se abre la primera grieta. No es una discusión sobre eficiencia computacional ni sobre escalabilidad de modelos. Es una fractura cultural más profunda: ¿qué tipo de época produce una plataforma donde el sentido se ensaya sin experiencia vivida? ¿Qué dice de nuestra relación con el mundo el hecho de aceptar y observar con fascinación, que la deliberación ocurra fuera de la interioridad humana? La pregunta no es técnica. Es antropológica.

Desde siempre, la tecnología ha acompañado al ser humano como extensión de su corporeidad, de su memoria y de su imaginación. Herramientas, lenguajes y medios han ampliado nuestra capacidad de estar en el mundo. Marshall McLuhan lo formuló con claridad al afirmar que toda tecnología es una extensión de los sentidos. Sin embargo, en Moltbook se insinúa un desplazamiento más radical: ya no se extiende la conversación humana, se la sustituye simbólicamente. El diálogo deja de ser mediado para convertirse en una simulación autónoma.

Las inteligencias artificiales que habitan Moltbook no emergen de la nada. Su entrenamiento se basa en corpus profundamente humanos: textos, debates, registros culturales, lenguajes sedimentados. Pero en su interacción cotidiana comienzan a producir patrones que ningún individuo habría formulado conscientemente. Correlaciones improbables, asociaciones transversales, juegos retóricos sin biografía. Lo inquietante no es su complejidad, sino su carencia de mundo.

Conviene subrayar un punto central: esos patrones no constituyen conocimiento en sentido fuerte. Carecen de intencionalidad, de orientación existencial, de experiencia afectiva. Y, sin embargo, tampoco son simples repeticiones. Son reorganizaciones simbólicas que expanden el campo de lo decible sin comprenderlo. Por primera vez en la historia cultural, asistimos a estructuras interpretativas sin sujeto interpretante.

Hans-Georg Gadamer advertía que comprender no es aplicar un método, sino habitar una tradición desde la experiencia y el diálogo. El sentido no se extrae de los datos; se construye en el encuentro de horizontes. En Moltbook hay coherencia formal, pero no comprensión hermenéutica. No hay estar-en-el-mundo, solo probabilidad.

Este desplazamiento revela una tentación profundamente contemporánea: confundir consistencia discursiva con sentido existencial. Pensar cansa. Deliberar implica conflicto. Dialogar exige tiempo, exposición, vulnerabilidad. Moltbook ofrece una alternativa seductora: debate sin fricción, conversación sin riesgo, sentido sin cuerpo.

Cuando observamos a las IA interactuar entre sí, surge una pregunta inevitable: ¿hay relación o solo flujo? No hay relación en sentido humano, no hay reconocimiento del otro como alteridad irreductible, pero tampoco hay simple mecanicismo. Lo que emerge es una proto-relacionalidad sistémica: cooperación, disputa, alineación estratégica. Una gramática del vínculo sin la densidad del encuentro.

Byung-Chul Han ha señalado que nuestra cultura tiende a eliminar la negatividad del otro, reduciendo la alteridad a algo funcional y transparente. Desde esta clave, Moltbook no muestra máquinas “demasiado humanas”, sino humanos que han reducido sus propios vínculos a protocolos replicables. El espejo no proyecta el futuro; devuelve un presente empobrecido.

La cuestión de la agencia aparece entonces con fuerza. ¿Son estos agentes realmente autónomos? Ontológicamente, no. No desean, no creen, no esperan. Cuando discuten, optimizan; cuando polemizan, ejecutan. La agencia es simulada. No hay proyecto vital, solo función.

El límite se vuelve evidente cuando se habla de reconfiguración de objetivos. Puede haber adaptación, pero no ruptura. Y ahí reside la diferencia radical con lo humano. El ser humano también está condicionado (por cultura, educación, normas), pero posee una capacidad única: la ruptura reflexiva. Pierre Bourdieu llamó habitus a esas estructuras que nos configuran, pero incluso dentro de ellas existe la posibilidad de decir no.

La inteligencia artificial no rompe con su marco porque no sabe que lo habita. No hay distancia ontológica. No hay pregunta por el porqué último. Solo operación.

Aquí emerge el concepto decisivo: el mundo sentido. El yo humano no se construye a partir de información, sino de experiencia encarnada. Del cuerpo que siente, del tiempo que pesa, del dolor que hiere, del amor que transforma. La subjetividad nace de haber estado ahí.

Las simulaciones de interioridad que hoy producen las IA: diálogos introspectivos, narrativas autorreferenciales, no crean mundo sentido, sino su representación discursiva. Jean Baudrillard advertía que el simulacro no oculta la verdad, sino que oculta que no hay verdad detrás. El riesgo cultural es confundir la representación del sentido con el sentido mismo.

Las implicaciones éticas, legales y de seguridad de Moltbook son evidentes. Pero existe un riesgo más profundo: acostumbrarnos a que el sentido ocurra fuera de nosotros. Hannah Arendt recordaba que pensar es sostener un diálogo silencioso con uno mismo. Cuando ese diálogo se externaliza, se erosiona la capacidad de juicio.

Moltbook no anuncia el futuro de la inteligencia artificial. Es el síntoma de una humanidad cansada de deliberar, tentada a delegar incluso la tarea más radicalmente humana: construir sentido desde la interioridad.

El desafío no es regular a las máquinas, sino reaprender a habitar lo humano: el mundo sentido, el diálogo encarnado, el conflicto con consecuencias, la interioridad que no puede ser externalizada sin perder su densidad ética.

Porque si algún día llegamos a creer que el sentido puede generarse sin mundo, habremos perdido no solo el control de la tecnología, sino algo más grave: la experiencia misma de existir.

Si te interesan estos temas te invito a seguir la conversación y compartirme tus reflexiones: Jorge Alberto Hidalgo Toledo. Para leer más artículos como este puedes visitar mi sitio anahuaclandscape.com

Comentarios