La paradójica batalla de Google contra los deepfakes de YouTube

- 23 oct 2025

- 3 Min. de lectura

Actualizado: 30 abr

Por Eduardo Portas Ruiz // Profesor investigador del Centro de Investigación para la Comunicación Aplicada (CICA) de la Universidad Anáhuac México

El meme lo sintetiza claramente. YouTube recibe dinero de anunciantes para mostrarle a los usuarios, los cuales a su vez le pagan a la plataforma para bloquearlos.

Un concepto tan maquiavélico que parece tomado de un episodio de Los Simpsons.

Pero el Sr. Burns se movía en el mundo de la caricatura satírica. La compañía Alphabet (el mega grupo que incluye todos los servicios de Google), por el contrario, toca la vida de millones de personas todos los días.

La frase no es exagerada. Unas 2.5 mil millones de personas usan YouTube cada mes. Gmail es utilizado por 1.8 mil millones de seres humanos. Cada día se hacen unos 8.5 mil millones de búsquedas en el navegador Google, el cual domina 90% del mercado y dede hace un buen rato implantó su dominio sobre Yahoo y Bing.

Imposible separar el mundo digital de la compañía. Esto trae problemas, además de acusaciones de tácticas monopólicas.

La última paradoja del universo Google estriba en el uso de la Inteligencia Artificial y las herramientas para combatir los deepfakes que cada día se vuelven más populares.

Un deepfake es video artificial de una persona que logra hacerse pasar por real. Los trastornos éticos frente a este realidad apenas se están entendiendo. Hasta hace unos meses era relativamente difícil crear un deepfake, pues las tecnologías de IA aún no llegaban al nivel requerido para considerarse como aceptable.

Pero en los últimos meses dos iniciativas han modificado este entorno. Primeramente, la salida al mercado de la app Sora, de OpenAI. Al posicionarla como una nueva red social, los dueños de ChatGPT han dado un enorme empuje a la normalización de deepfake con todas las consecuencias negativas que esto implica.

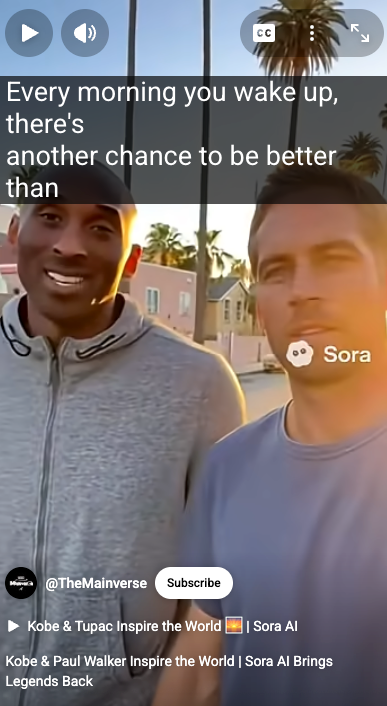

Todos los días aparecen videos en Sora en donde se ve la efigie de una personalidad fallecida (Robin Williams, Nelson Mandela, Paul Walker, etc.) haciendo algo que nunca hizo o que nunca dijo. Las familias de estas personas se han quejado con OpenAI, pero los resultados han caído en oídos sordos.

Lo mismo las compañías que han visto una tonelada de videos hecho con IA con sus marcas registradas (Nintendo, por ejemplo).

OpenAI, por el momento, se ha mantenido firme en su decisión de permitir estas creaciones bajo la égida de la libertad de expresión. A este momento, nadie sabe si la tendencia durará lo suficiente como para olvidar la novedad de ver a Paul Walker caminando junto a Kobe Bryant mientras enuncian frases motivacionales.

El segundo gran hecho es el lanzamiento de Veo 3 y 3.1, el sistema de creación de videos hechos con IA del propio Google.

Ambos fenómenos mediáticos auguran una era de deepfakes en donde lo normal será asumir que lo que se observa en una pantalla es falso, en lugar de lo contrario.

Diversas investigaciones confirman esta tendencia. La línea entre lo que la gente considera real se difumina o se vuelve imposible de cotejar cuando llega la pantalla.

Para contrarrestar esta ola, YouTube lanzó su sistema de detección de similitud facial, una iniciativa que pretende proteger a los creadores de contenido de actores maliciosos que quieran suplantar su identidad en esta plataforma.

El sistema debe habilitarse de forma manual y requiere que la persona aporte sus datos biométricos y una identificación oficial.

Los resultados son inciertos, pero YouTube asegura que con estos datos puede detectar un video “en donde tu cara podría haber sido alterada o generada por IA”.

Nótese que la compañía no usa el término deepfake. Tal vez le pareció demasiado escandaloso.

La realidad es que, más allá de la eficiencia de la herramienta, la creación de la misma revela la paradójica era en la que nos encontramos. Queremos mantener nuestra identidad unificada mientras nuestro ser digital se desdobla en distintos lugares, en distintos momentos.

En X: EduPortas

Human performance in deepfake detection: A systematic review

Las instrucciones de YouTube para habilitar la herramienta de detección de similitud facial se encuentra aquí

Un listado en orden cronológico inverso de textos escritos por Eduardo Portas en Anáhuac Landscape desde 2025 se puede ver aquí:

Comentarios